如何完美解锁DeepSeek-R1的结构化输出能力(基于LangChain)?

结构化输出就是大模型在生成响应时,以一种有结构的规范化形式呈现,而不是自由文本。这种结构化的输出通常包括预定义的字段、标签、列表、表格、或者其他形式的组织化数据,而最常见也是最灵活的一种表达形式就是JSON。

DeepSeek-R1这样的推理模型有着强大的深度思考能力,但也有着一些不同于通用模型的特点与用法,比如不支持函数调用,不支持结构化输出,o1甚至不支持系统提示(System Prompt)等。尽管这和它们的使用场景有关,但有时也会带来不便。今天我们就来说说结构化输出这个常见的问题。

1、理解结构化输出

【什么是结构化输出】

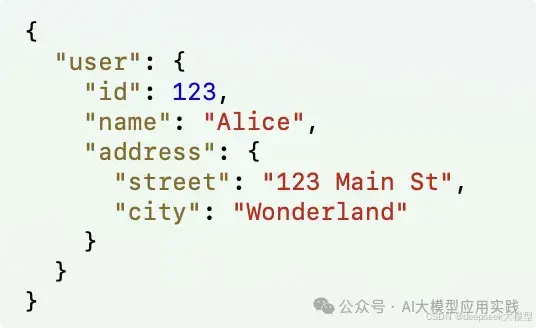

结构化输出就是大模型在生成响应时,以一种有结构的规范化形式呈现,而不是自由文本。这种结构化的输出通常包括预定义的字段、标签、列表、表格、或者其他形式的组织化数据,而最常见也是最灵活的一种表达形式就是JSON。比如输出一个结构化的用户信息可能如下:

【为什么需要结构化输出】

结构化输出的最大意义在于:提供一种更易于程序处理的标准化数据交换格式,极大地方便应用的后续解析与处理。这些后续处理比如:

- 将提取的信息导入关系型数据库

- 自动化的填写web表格/表单

- 对接外部或者企业的API

这种能力对于企业级的应用,特别是在多步骤任务的Agent中,可以极大方便后续步骤的处理,并减少LLM带来的不确定性。举一个例子:

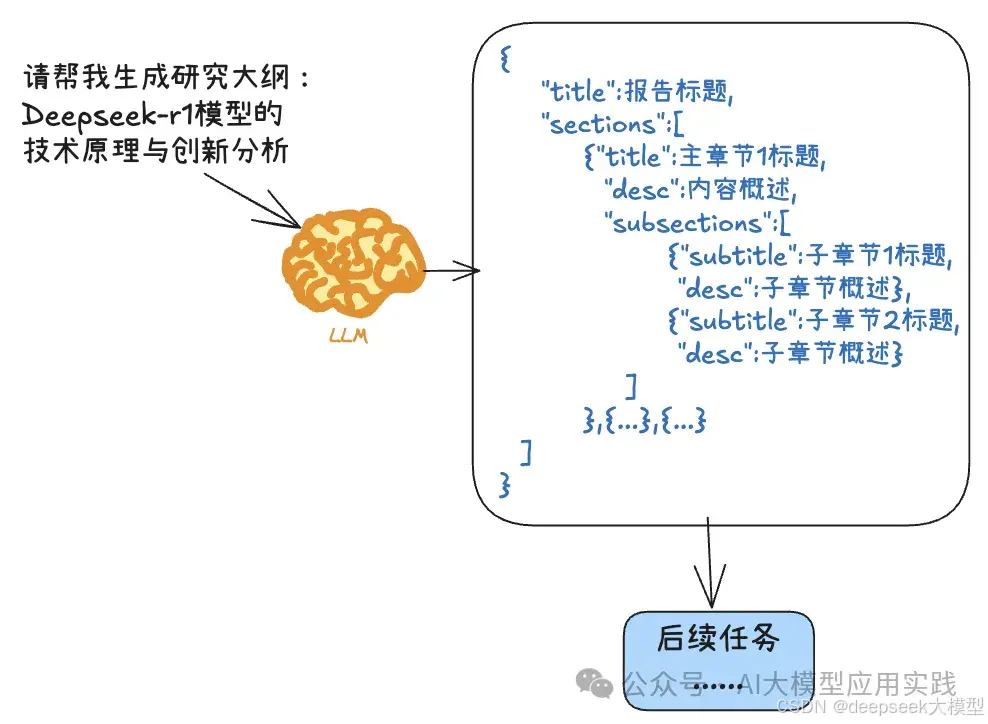

在一个自主学术研究的Agent中,希望借助DeepSeek-R1的深度思考能力,首先生成完善的研究大纲,后续再根据大纲对每一个子主题借助搜索引擎、RAG等获取参考资料,并做进一步研究。

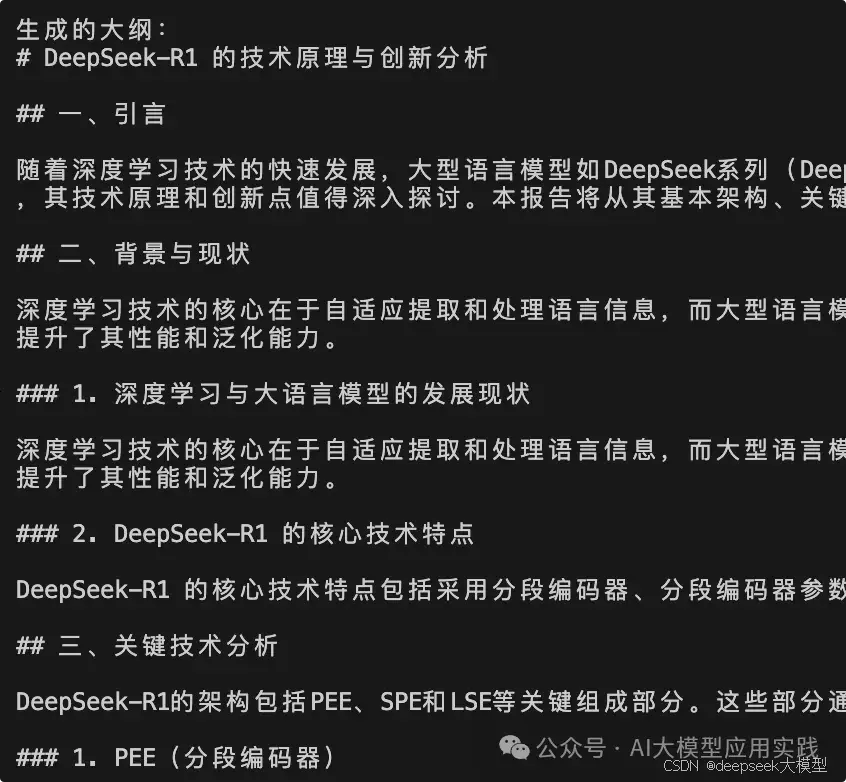

在这个例子中,我们希望DeepSeek输出的大纲如下:

很显然,这样的输出会更方便后续程序的理解与处理。

【结构化输出的常见方式】

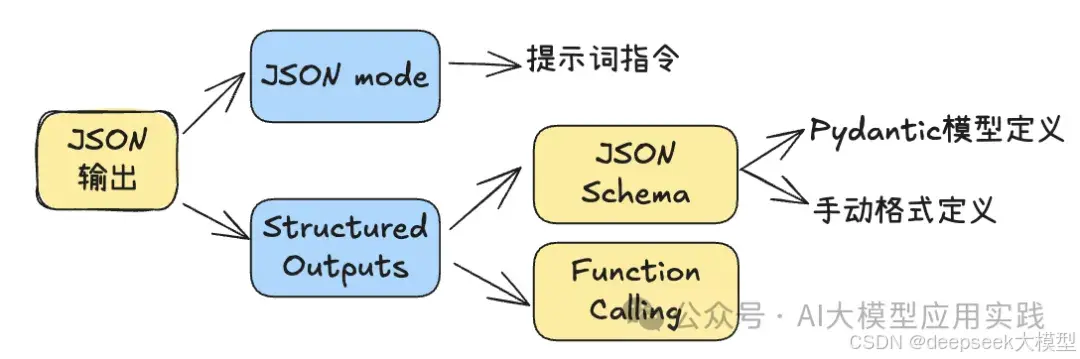

对于目前的很多通用模型来说,结构化输出已经不再是一个障碍,你可以通过模型提供的API参数进行强制。比如gpt-4o目前支持几种主要的结构化输出方式:

除了Function Calling(这必然会产生结构化输出)外:

- JSON mode:需要使用提示词进行限定,并在API参数中指定响应格式为json_object,这种方式可以确保输出有效的JSON格式,但具体格式需要借助提示(目前一些模型还只支持这种方式,比如阿里的qwen)。

- JSON Schema:使用更加便捷,通过API传入定义的JSON Schema或者Pydantic模型即可,无需借助提示词。这种方式可以直接输出指定的对象,无需自解析。比如对于上面的例子,你可以要求模型直接输出以下的Outline对象:

# 数据模型定义

class Subsection(BaseModel):

"""子章节"""

subsection_title: str = Field(..., description="子章节的标题")

description: str = Field(..., description="子章节的详细内容描述")

class Section(BaseModel):

"""主要章节及其包含的子章节"""

section_title: str = Field(..., description="章节标题")

description: str = Field(..., description="章节内容概述")

subsections: Optional[List[Subsection]] = Field(

default=None,

description="本章节中的子章节",

)

class Outline(BaseModel):

"""完整大纲"""

page_title: str = Field(..., description="报告标题")

sections: List[Section] = Field(

default_factory=list,

description="文章的主要章节",

)

当你指定这里的Outline为输出格式时,API将会直接返回你Outline类型的对象,极大的方便了后续处理。

那么现在我们需要deepseek来帮助完成Agent的某个步骤,同时希望获得稳定的结构化输出,应该如何处理呢?接下来介绍两种方式。

2、借助辅助模型处理

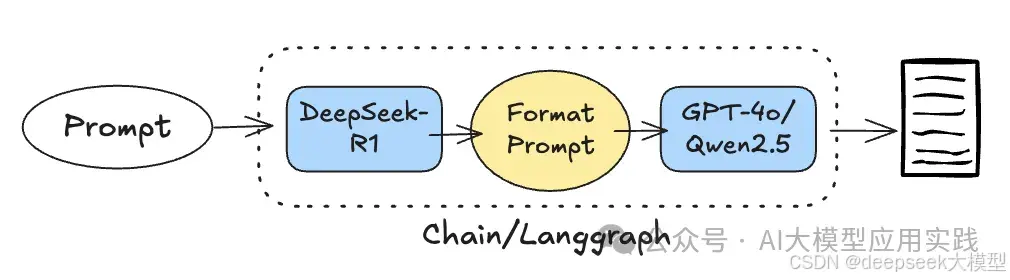

这种方法融合DeepSeek-R1的深度思考能力与通用模型的结构化输出能力(如GPT-4o):将R1的推理结果借助一个“辅助”模型进行“格式化”后输出,概念流程如下:

具体到LangChain框架中,实现这种顺序流的方式又有两种,这里依次介绍。

【Chain链】

Chain是LangChain中最核心的概念。它将多个步骤或组件连接在一起,实现复杂的处理任务。借助LCEL(Langchain表达式语言)可以快速构建这个Chain:

......

# deepseek提示

system_prompt_deepseek = ChatPromptTemplate.from_template("""

针对用户提供的主题, 撰写一篇研究报告的大纲。要求全面且具体。我的主题:{topic}

""")

# 内容格式化提示

system_prompt_format = ChatPromptTemplate.from_template("""

你是一个内容格式化专家, 只负责将输入内容转化为结构化输出, 不要做额外思考。我的内容:{draft}

""")

# deepseek模型

llm_ollama_deepseek = ChatOllama(model='deepseek-r1:1.5b')

# openai模型:使用with_structured_output强制结构化输出

llm_openai = ChatOpenAI(model='gpt-4o-mini').with_structured_output(Outline)

# 创建 LangChain 的 chain

chain = system_prompt_deepseek | llm_ollama_deepseek | system_prompt_format | llm_openai

我们对这个Chain进行测试:

......

response = await chain.ainvoke({"topic":"deepseek-r1的技术原理与创新分析"})

print("\n生成的大纲:")

print(response.as_str)

输出如下,我们可以得到一个非常干净的结构化输出的大纲(这里输出的response实际是一个上面定义的Outline对象,这里通过一个简单的as_str进行转化打印):

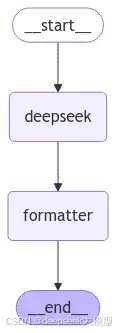

【LangGraph工作流】

既然是一个流式任务,当然也可以通过LangGraph来实现,构建这样一个简单的Graph即可:

这里核心的state与node定义如下:

...

class State(TypedDict):

"""图的状态类型"""

topic: str

draft: str | None

output: Outline | None

def deepseek_node(state: State) -> State:

"""使用deepseek模型处理输入任务"""

ollama = ChatOllama(model="deepseek-r1:1.5b")

messages = [SystemMessage(content='针对用户提供的主题,撰写一篇研究报告的大纲。要求全面且具体'),

HumanMessage(content=state["topic"])]

response = ollama.invoke(messages)

state["draft"] = response.content

return state

def formatter_node(state: State) -> State:

"""使用GPT-4o处理并格式化输出"""

llm = ChatOpenAI(model="gpt-4o-mini").with_structured_output(Outline)

messages = [SystemMessage(content='你是一个内容格式化专家,只负责将输入内容转化为结构化输出,不要做额外思考'),

HumanMessage(content=f'我的内容: {state["draft"]}')]

response = llm.invoke(messages)

state["output"] = response

return state

剩下的工作就是创建Graph并测试,交给读者们自行完成。

以上的两种方法(Chain或者Graph)都可以达到相同的目的,Chain实现相对简洁,适合在普通的应用中使用;而如果你本身就是一个需要使用LangGraph来实现的复杂Agent应用,那么可以参考第二种:增加一个专门的formatter节点即可。

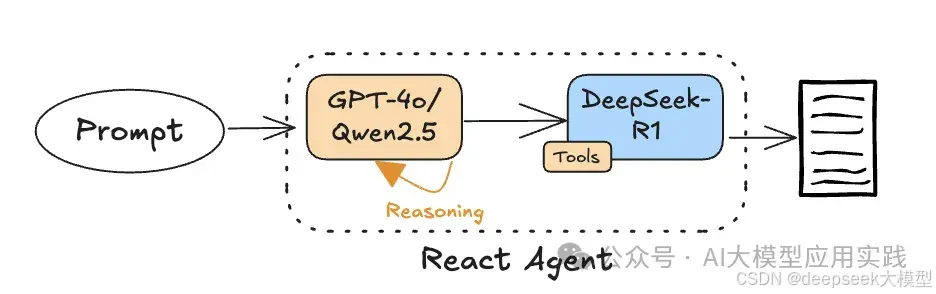

3、借助ReActAgent实现

这种方法的思想是借助Agent的思想,让deepseek的深度思考作为一个Agent可以使用的工具,在这个工具(使用deepseek模型)获得思考结果后,再通过结构化输出的模型进行格式化(使用gpt-4o模型)。概念如下图:

由于这是一个React类型的Agent,因此其更适合在多Agent应用环境中使用,让其与其他Agent通过协作完成更复杂的任务。

【构建Tool】

首先创建一个使用deepseek-r1进行思考的工具,输入是研究主题,输出则是思考结果(自由文本表达的研究大纲)。

@tool

def deepseek_research(prompt: str) -> str:

"""

对输入的研究任务进行思考,并生成研究大纲的草稿

args:

prompt(str): 输入的研究任务描述

return:

result(str): 思考结果

"""

print('start think...')

messages = [HumanMessage(content=f'针对用户提供的主题,撰写一篇研究报告的大纲。要求全面且具体。我的主题:{prompt}')]

result = llm_ollama_deepseek.invoke(messages)

print(result.content)

return result.content

【创建ReAct Agent】

借助LangChain的prebuilt函数快速的构建一个ReAct Agent来使用这个Tool。为了让这个Agent必须使用这个Tool,可能需要在提示词上适当调优。参考如下代码:

...

llm = ChatOpenAI(model='gpt-4o-mini')

agent = create_react_agent(llm, response_format=Outline, tools=[deepseek_research])

response = agent.invoke({"messages":[

SystemMessage(content="请首先使用工具(deepseek_research)来生成研究大纲草稿,然后对草稿进行格式化输出。请注意把输入主题直接交给工具,不要做思考与加工。以下是我的研究主题。"),

HumanMessage(content="deepseek-r1技术原理与创新分析")]})

last_message = response["structured_response"]

print(last_message.as_str)

注意这里与上面两种方法的不同之处在于:不直接调用llm的with_structured_output方法,而是在create_react_agent方法中指定response_format参数(本质上一样)。

4、其他问题

以上展示了两种方法来给DeepSeek-R1这样的推理模型“嫁接”上稳定的结构化输出的能力,以帮助在复杂的企业级应用中对接其他流程或任务。

这里还有最后一个问题:如果我的辅助模型不是gpt-4o这样具备便捷的结构化输出接口的模型怎么办(即不支持使用JSON Schema或者Pydantic模型定义输出格式)?方法就是借助JSON mode,以qwen模型为例,通常包括几个步骤:

- 在API调用时指定JSON mode,比如qwen系列模型中:

response_format={"type": "json_object"}

- 在提示词中明确要求进行JSON结构化输出,并指定格式。

- 由于这种方式的API不会直接输出对象,因此你需要对结果字符串做解析:

json_object = json.loads(result)

OK,借助以上介绍的几种方法,现在你可以把DeepSeek更加如鱼得水接入到你的应用中,感受其强大的威力。

我的DeepSeek部署资料已打包好(自取↓)

https://pan.quark.cn/s/7e0fa45596e4

但如果你想知道这个工具为什么能“听懂人话”、写出代码 甚至预测市场趋势——答案就藏在大模型技术里!

❗️为什么你必须了解大模型?

1️⃣ 薪资爆炸:应届大模型工程师年薪40万起步,懂“Prompt调教”的带货主播收入翻3倍

2️⃣ 行业重构:金融、医疗、教育正在被AI重塑,不用大模型的公司3年内必淘汰

3️⃣ 零门槛上车:90%的进阶技巧不需写代码!会说话就能指挥AI

(附深度求索BOSS招聘信息)

⚠️警惕:当同事用DeepSeek 3小时干完你3天的工作时,淘汰倒计时就开始了。

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?老师啊,我自学没有方向怎么办?老师,这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!当然这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)