GAN网络详解析

介绍目前常见的GAN网络,以及GAN网络的基本组成

前言

生成对抗网络(GAN)是由生成器和判别器组成的深度学习模型,它们相互竞争以学习和生成类似于训练数据的新样本。

一、GAN网络

1.1 基本组成

-

生成器(Generator):

- 生成器接受随机噪声或潜在空间向量作为输入,并将其映射到数据空间,以生成假样本。

- 它通常由一系列反卷积(或转置卷积)层和激活函数组成,用于将潜在空间向量映射到数据空间,并生成逼真的样本。

-

判别器(Discriminator):

- 判别器接受真实样本(来自训练数据)和生成器生成的假样本,并尝试区分它们。

- 它通常由一系列卷积层和激活函数组成,用于从输入样本中提取特征并输出一个概率,表示输入样本是真实样本的概率。

-

损失函数(Loss Function):

- GAN使用两个不同的损失函数:生成器损失和判别器损失。

- 生成器损失通常是判别器对生成样本的错误分类,即生成器试图生成更逼真的样本以欺骗判别器。

- 判别器损失是判别器正确分类真实样本和生成样本的能力,即判别器尽可能准确地区分真实和生成的样本。

-

优化器(Optimizer):

- 生成器和判别器都需要使用优化算法来更新其参数以最小化其各自的损失函数。

- 常用的优化算法包括随机梯度下降(SGD)、Adam等。

这些是GAN网络的基本组成部分,它们共同作用以促进生成器生成逼真的样本,并使判别器能够准确地区分真实和生成的样本。

简单的GAN网络

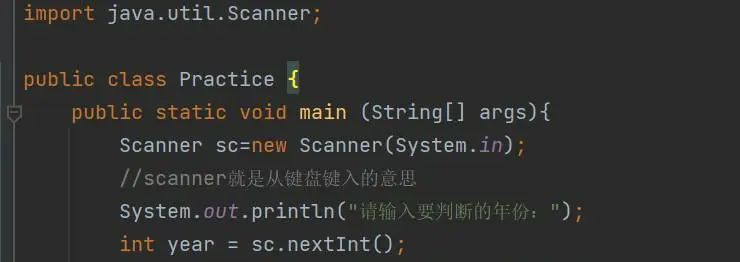

为了构建一个简单的生成对抗网络(GAN)框架,我们可以使用Python中的PyTorch库,这是一个广泛使用的深度学习库,非常适合构建和训练神经网络。下面我将提供一个用于生成手写数字的简单GAN模型的代码示例,这个模型将基于MNIST数据集进行训练。

1. 导入必要的库

首先,我们需要导入PyTorch及相关工具库:

import torch

from torch import nn, optim

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

from torchvision.utils import save_image

import os

2. 定义生成器和判别器

这里定义两个网络:生成器(Generator)和判别器(Discriminator)。

class Generator(nn.Module):

def __init__(self):

super(Generator, self).__init__()

self.model = nn.Sequential(

nn.Linear(100, 256),

nn.LeakyReLU(0.2),

nn.Linear(256, 512),

nn.LeakyReLU(0.2),

nn.Linear(512, 1024),

nn.LeakyReLU(0.2),

nn.Linear(1024, 784),

nn.Tanh() # 输出像素值在[-1, 1]之间

)

def forward(self, z):

return self.model(z).view(-1, 1, 28, 28)

class Discriminator(nn.Module):

def __init__(self):

super(Discriminator, self).__init__()

self.model = nn.Sequential(

nn.Linear(784, 512),

nn.LeakyReLU(0.2),

nn.Linear(512, 256),

nn.LeakyReLU(0.2),

nn.Linear(256, 1),

nn.Sigmoid()

)

def forward(self, img):

img_flat = img.view(img.size(0), -1)

return self.model(img_flat)

3. 初始化网络和优化器

generator = Generator()

discriminator = Discriminator()

g_optimizer = optim.Adam(generator.parameters(), lr=0.0002, betas=(0.5, 0.999))

d_optimizer = optim.Adam(discriminator.parameters(), lr=0.0002, betas=(0.5, 0.999))

4. 定义损失函数和数据加载器

criterion = nn.BCELoss()

dataloader = DataLoader(

datasets.MNIST('.', train=True, download=True,

transform=transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.5,), (0.5,))

])),

batch_size=32, shuffle=True)

5. 训练GAN

for epoch in range(50):

for i, (imgs, _) in enumerate(dataloader):

real_imgs = imgs

valid = torch.ones(imgs.size(0), 1)

fake = torch.zeros(imgs.size(0), 1)

# 训练判别器

d_optimizer.zero_grad()

real_loss = criterion(discriminator(real_imgs), valid)

z = torch.randn(imgs.size(0), 100)

fake_imgs = generator(z)

fake_loss = criterion(discriminator(fake_imgs.detach()), fake)

d_loss = real_loss + fake_loss

d_loss.backward()

d_optimizer.step()

# 训练生成器

g_optimizer.zero_grad()

g_loss = criterion(discriminator(fake_imgs), valid)

g_loss.backward()

g_optimizer.step()

print(f"Epoch {epoch}: D Loss: {d_loss.item()}, G Loss: {g_loss.item()}")

if epoch % 10 == 0:

save_image(fake_imgs.data[:25], f'epoch{epoch}.png', nrow=5, normalize=True)

这个示例定义了基本的GAN框架,包括网络结构、损失函数和训练循环。你可以调整各种参数来优化性能,或根据需要修改网络结构。

二、变体GAN

生成对抗网络(GAN)自从2014年由Ian Goodfellow等人提出后,已经衍生出许多变种,每种都试图解决原始GAN面临的一些挑战,如训练稳定性、模式崩溃、和生成样本的多样性和质量。以下是一些主要的GAN变种:

-

条件生成对抗网络(Conditional GAN, CGAN):

- 条件GAN通过向生成器和判别器中引入额外的条件信息(如类标签),使生成的样本具有特定的特征。这使模型能够控制生成过程中的样本类型。

-

深度卷积生成对抗网络(Deep Convolutional GAN, DCGAN):

- DCGAN使用深度卷积网络作为生成器和判别器,显著改进了生成图像的质量和稳定性。DCGAN遵循一组特定的架构准则,如使用strided convolutions和batch normalization。

-

Wasserstein GAN(WGAN):

- WGAN通过使用Wasserstein距离(一种测量两个分布之间距离的方法)来改善训练过程。WGAN解决了传统GAN训练中的一些问题,比如训练不稳定和模式崩溃,使训练过程更加平稳。

-

WGAN-GP(Wasserstein GAN with Gradient Penalty):

- 在WGAN的基础上,WGAN-GP引入了梯度惩罚来进一步改进训练过程,使得模型更加稳定,同时简化了超参数的选择过程。

-

CycleGAN:

- CycleGAN用于图像到图像的转换任务,例如风格迁移,无需成对的训练样本。它通过引入循环一致性损失来确保输入图像和转换后图像之间的一致性。

-

pix2pix:

- pix2pix是一种条件式GAN,用于监督学习场景下的图像到图像转换,需要成对的图像(例如,白天到夜晚的场景)。它使用U-Net作为生成器和PatchGAN作为判别器。

-

StyleGAN:

- StyleGAN由NVIDIA开发,能生成极其逼真的高分辨率图像。StyleGAN在生成器中引入了一个风格转移机制,允许用户通过操纵潜在空间来控制生成图像的特定方面。

-

BigGAN:

- BigGAN是在大规模数据集上训练的GAN,它通过使用更大的模型和更多的训练数据来生成高质量的图像。BigGAN展示了通过增加模型规模和训练稳定性可以显著提高生成图像的质量。

-

自适应动量估计GAN(Least Squares GAN, LSGAN):

- LSGAN通过将判别器的损失函数从原始的交叉熵损失改为最小二乘损失,来解决GAN训练中的不稳定问题。这有助于生成器产生更高质量的图像。

-

辅助分类GAN(Auxiliary Classifier GAN, ACGAN):

- ACGAN在生成器和判别器的基础上添加了辅助分类器,使判别器不仅判断输入是真实的还是生成的,同时还进行类别预测。这使生成的样本类别更加精确。

-

堆叠GAN(StackGAN):

- StackGAN通过多个阶段的生成器和判别器来逐步提高图像的分辨率和质量。每个阶段都在前一个阶段的基础上增加更多细节,从而生成高分辨率的图像。

这些变种通过不同的技术和架构改进来解决GAN的各种挑战,同时拓展GAN的应用领域,从简单的图像生成到复杂的图像到图像转换和超高分辨率图像生成等任务。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)