《人工智能:CSDN 平台上的璀璨之星》

机器学习是一种让计算机系统具备从数据中学习的能力,并通过学习不断优化和改进性能的技术。它主要分为监督学习、无监督学习和强化学习三种类型。在监督学习中,通过已标记的数据进行训练,学习输入数据与输出标签之间的关系,以预测未知数据的标签。例如,在垃圾邮件检测中,通过已标记的 “垃圾邮件” 和 “非垃圾邮件” 数据来训练模型,从而对新邮件进行分类。无监督学习则处理未标记的数据,探索数据之间的关系和结构。常

一、CSDN 上的 AI 热门话题

GPT-3 作为 CSDN 上的热门话题,其应用极为广泛。GPT-3 是 OpenAI 开发的一种基于 Transformer 架构的大规模预训练语言模型,拥有惊人的 1750 亿个参数。它具有多任务处理能力,能够执行多种自然语言处理任务,如文本生成、翻译、问答、文本摘要、阅读理解等。同时,GPT-3 还具有零样本和少样本学习能力,能够在没有特定任务训练的情况下,仅通过自然语言的描述就能执行新的任务,即使只给出少量的任务示例,也能迅速适应并完成任务。此外,GPT-3 能够理解长段落的上下文信息,并在生成文本时考虑到这些信息。

在应用场景方面,GPT-3 可以生成高质量的文本,如文章、故事、新闻等,在内容创作领域具有广阔的应用前景。它也可以作为对话系统的后端引擎,实现与用户的自然交互。例如,在一些智能客服系统中,GPT-3 可以根据用户的问题快速生成准确的回答,提高客户服务的效率和质量。

然而,GPT-3 也存在一些局限性和挑战。例如,它可能生成不准确或偏见的内容,以及对于特定领域的专业知识理解可能有限。因此,在使用 GPT-3 时,需要谨慎处理其输出,并结合专业知识进行验证和修正。

总的来说,GPT-3 作为 CSDN 上的热门话题,其强大的性能和广泛的应用前景吸引了众多开发者和研究者的关注。随着技术的不断发展,相信 GPT-3 将会在更多的领域发挥重要作用。

二、2023 年技术热点与 AI

(一)AI 引领技术革命

人工智能在多个领域发挥着重要作用,引领着技术革命的浪潮。在农业领域,人工智能可以通过无人机进行农药喷撒、除草作业,还能对农作物状态进行实时监控,实现物料采购、数据收集、灌溉、收获和销售的智能化管理,大大提高了农牧业的产量,降低了人工成本和时间成本。在通信领域,智能外呼系统、客户数据处理、通信故障排除、骚扰信息拦截等方面都离不开人工智能技术。医疗领域中,人工智能可用于健康监测、自动提示用药时间和禁忌、智能辅助诊断等,为医患提供更多解决方案。社会治安方面,安防监控、电信诈骗数据锁定、犯罪分子抓捕、消防抢险等任务也越来越多地借助人工智能实现。交通领域的航线规划、无人驾驶汽车以及对超速、行车不规范等行为的整治,都展现了人工智能的强大实力。服务业中,餐饮行业的点餐、传菜、回收餐具和清洗,订票系统的查询、预定、修改和提醒等功能也在人工智能的助力下更加高效便捷。金融行业利用股票证券的大数据分析、行业走势分析和投资风险预估等,提升决策的准确性。此外,人工智能在教育领域通过图像识别进行机器批改试卷、识题答题,通过语音识别纠正发音,人机交互在线答疑解惑等,为师生提供更有效率的学习方式。可以说,人工智能已经涵盖了多个领域,为我们提供了更便捷、更高效的服务,让我们站在了技术革命浪潮之巅。

(二)大数据释放价值

大数据作为 IT 行业术语,是指无法在一定时间范围内用常规软件工具进行捕捉、管理和处理的数据集合。在各行各业中,大数据技术的应用正在成为一种核心竞争力。通过挖掘海量数据中的价值,企业可以更精准地把握市场需求,实现精细化运营。例如,电商平台通过分析用户的浏览记录、购买行为、评价等数据,能够为用户提供个性化的推荐商品,提高用户的购买转化率。同时,大数据还能帮助电商企业优化库存管理,预测销售趋势,从而降低成本,提高运营效率。在金融领域,银行和金融机构利用大数据进行风险评估和信用评分。通过分析客户的消费习惯、财务状况、信用记录等多维度数据,能够更精准地评估客户的信用风险,做出更明智的信贷决策。此外,大数据还能帮助金融机构发现欺诈行为,保障金融交易的安全。在医疗行业,通过收集和分析大量的患者病历、医疗影像、临床实验数据等,医疗机构能够更准确地诊断疾病,制定个性化的治疗方案。同时,大数据还可以提前预测疾病的爆发趋势,从而及时采取防控措施,保障公众健康。总之,大数据技术在各行业的应用,挖掘了海量数据的价值,实现了精细化运营和提升公共服务能力。

(三)区块链重塑信任

区块链技术是一种基于去中心化、去信任化的集体维护数据库技术,它允许网络中的参与者在不需要中心化信任机构的情况下进行安全、可追溯、不可篡改的数据交换和传输。区块链技术的核心思想是去中心化,它通过密码学算法保证数据传输和访问的安全,数据由全网节点共同维护,不被任何单一机构或个人所控制。在金融领域,区块链技术可以确保交易的透明性和安全性,防止欺诈和腐败行为的发生。同时,区块链技术还能大幅降低金融交易的成本,提高效率,使得金融服务能够更广泛地惠及社会各个层面的人群。在供应链管理中,区块链技术通过将每个环节的信息记录在链上,并允许相关方进行实时查询,从而提高了供应链的透明度和可追溯性。这种透明的供应链管理模式,不仅可以提高效率,还可以防止假冒伪劣产品的流通,保障消费者的权益。通过区块链技术的应用,可以重建供应链上的信任关系,从而推动全球贸易的健康发展。在政务管理中,区块链技术可以为政务管理带来新的解决方案,通过公开透明的记录和不可篡改的特性,政府可以更有效地管理公共事务,防止腐败和滥用职权行为的发生。例如,在选举中应用区块链技术,可以确保选票的真实和透明,防止选举舞弊行为,从而提升选举的公信力和社会的整体信任度。总之,区块链技术正在金融、供应链、政务等领域发挥重要作用,重塑信任体系,降低交易成本,提高交易效率。

(四)5G 开启新时代

5G 作为第五代移动通信技术,它是一种高速、低时延的无线通信技术。5G 技术具有高速率、低时延和大连接特点。高速率能够实现数据传输效率的指数级跃迁,为新的传播手段应用提供可能。低时延理论上优于人的生理反应时间,可以做到实时反应,为一些对精确度、安全度有极高要求的技术手段的应用扫除障碍。大连接的超大连接容量可以在人员密度大、使用需求高的区域依然实现高速数据传输。5G 的应用场景主要包括高铁、地铁等连续广域覆盖场景;住宅区、办公区、露天集会等热点高容量场景;智慧城市、环境监测、智能农业等低功耗大连接场景;车联网、工业控制、虚拟现实、可穿戴设备等低时延高可靠场景。在智能交通领域,5G 技术将发挥关键作用,实现人、物、设备之间的实时通信,提高交通效率和安全性。在工业自动化领域,5G 技术可以实现设备的远程控制和监测,提高生产效率和质量。在智慧医疗领域,5G 技术可以实现远程医疗、医疗影像的实时传输和分析,提高医疗服务的可及性和质量。总之,5G 网络的普及将为我们带来前所未有的互联体验,开启万物互联新时代,推动各行业实现数字化转型。

(五)成为技术领先者的方法

要成为技术领先者,我们需要采取一系列的措施。首先,持续学习是至关重要的。技术是日新月异的,保持学习的热情和动力,参与在线课程、研讨会、技术会议等,可以不断充实自己的知识和技能。其次,关注前沿动态。密切关注行业前沿技术动态,了解最新研究成果和应用趋势。可以通过阅读科技期刊、博客、参与技术社区等方式获取信息。第三,实践与创新。将所学知识应用到实际工作中,不断积累经验。同时,要敢于创新,尝试新的技术方法和解决方案,拓展技术应用边界。第四,跨领域合作。技术领域的融合是未来发展的必然趋势。积极参与跨领域项目合作,与其他领域的专家交流,有助于拓宽视野,激发创新灵感。最后,培养团队精神。在技术发展中,团队精神至关重要。建立一个互帮互助、共同进步的技术团队,可以共同解决问题,提升整体技术水平。通过这些措施,我们可以在技术领域中不断进步,成为技术领先者。

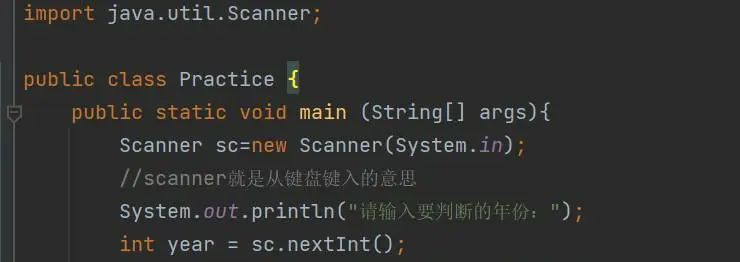

(六)经典代码案例

在人工智能领域,有许多经典代码案例可以帮助初学者快速上手并理解AI的核心概念。以下是一些精选的AI经典代码案例,它们涵盖了从基础的机器学习到复杂的深度学习应用:

-

TensorFlow案例: TensorFlow是Google开发的开源机器学习框架,广泛用于计算机视觉、自然语言处理等领域。例如,使用TensorFlow进行图像识别的代码案例,可以快速搭建一个模型来识别不同类别的图像。TensorFlow的高级API与Keras相似,简化了模型创建,同时低级API为高级用户提供了细粒度的控制。

-

PyTorch案例: PyTorch是由Facebook的AI研究团队开发的开源机器学习库,特别适合于研究和开发深度学习模型。一个经典案例是使用PyTorch构建一个简单的神经网络来处理MNIST手写数字识别任务,这有助于理解神经网络的基本概念和训练过程。

-

Scikit-learn案例: Scikit-learn是Python中一个广泛使用的机器学习库,它提供了简单有效的数据挖掘和数据分析工具。例如,使用Scikit-learn进行鸢尾花分类的案例,这是一个经典的机器学习入门案例,可以帮助初学者理解决策树和支持向量机等基本算法。

-

Keras案例: Keras是一个高层神经网络API,它能够运行在TensorFlow、CNTK或Theano之上。Keras的简化接口使得快速实验深度神经网络成为可能。一个经典案例是使用Keras构建一个深度神经网络来预测用户的电影评分,这个案例涉及到数据预处理、模型构建、训练和评估等关键步骤。

-

自然语言处理(NLP)案例: 使用Hugging Face的Transformers库,可以轻松地利用预训练模型进行文本分类、情感分析等任务。例如,使用BERT模型进行新闻文章分类的案例,展示了如何利用预训练的深度学习模型来处理复杂的NLP任务。

-

计算机视觉案例: 使用OpenCV进行实时图像处理的案例,如实时人脸识别或手势识别,这些案例通常涉及到图像的采集、处理和分析,展示了计算机视觉在实际应用中的潜力。

-

AI代码生成器案例: 如GitHub Copilot,它是一个AI驱动的代码生成器,可以实时生成代码补全,帮助开发者提高编码效率。Copilot通过分析公共代码存储库来提供智能的代码建议,这些建议不仅语法正确,而且能够适应开发者的个人编码风格。

-

AI在医疗领域的应用案例: 例如,使用AI进行疾病诊断的系统,通过分析医学影像数据(如X光片、CT扫描)来辅助医生进行诊断。这类案例通常涉及到图像处理、机器学习模型训练和评估等步骤。

这些案例不仅提供了实际的代码实现,还涵盖了从数据预处理到模型训练、评估和部署的整个机器学习流程,非常适合作为学习人工智能的起点。

当然,以下是一些使用不同框架和库的人工智能经典代码案例的具体代码示例:

1. TensorFlow案例:MNIST手写数字识别

python

import tensorflow as tf

from tensorflow.keras import layers, models

# 加载MNIST数据集

mnist = tf.keras.datasets.mnist

(x_train, y_train), (x_test, y_test) = mnist.load_data()

# 数据预处理

x_train, x_test = x_train / 255.0, x_test / 255.0

# 构建模型

model = models.Sequential([

layers.Flatten(input_shape=(28, 28)),

layers.Dense(128, activation='relu'),

layers.Dropout(0.2),

layers.Dense(10)

])

# 编译模型

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

# 训练模型

model.fit(x_train, y_train, epochs=5)

# 评估模型

model.evaluate(x_test, y_test)2. PyTorch案例:MNIST手写数字识别

python

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

# 数据预处理

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.5,), (0.5,))

])

trainset = datasets.MNIST('~/.pytorch/MNIST_data/', download=True, train=True, transform=transform)

trainloader = torch.utils.data.DataLoader(trainset, batch_size=64, shuffle=True)

testset = datasets.MNIST('~/.pytorch/MNIST_data/', download=True, train=False, transform=transform)

testloader = torch.utils.data.DataLoader(testset, batch_size=64, shuffle=False)

# 构建模型

class NeuralNet(nn.Module):

def __init__(self):

super(NeuralNet, self).__init__()

self.flatten = nn.Flatten()

self.linear_relu_stack = nn.Sequential(

nn.Linear(28*28, 512),

nn.ReLU(),

nn.Linear(512, 512),

nn.ReLU(),

nn.Linear(512, 10)

)

def forward(self, x):

x = self.flatten(x)

logits = self.linear_relu_stack(x)

return logits

model = NeuralNet()

# 损失函数和优化器

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.9)

criterion = nn.CrossEntropyLoss()

# 训练模型

for epoch in range(5):

running_loss = 0

for images, labels in trainloader:

optimizer.zero_grad()

log_ps = model(images)

loss = criterion(log_ps, labels)

loss.backward()

optimizer.step()

running_loss += loss.item()

else:

print(f"Training loss: {running_loss/len(trainloader)}")

# 评估模型

correct = 0

total = 0

with torch.no_grad():

for images, labels in testloader:

images = images.view(images.shape[0], -1)

log_ps = model(images)

_, class_ps = torch.max(log_ps, 1)

total += labels.size(0)

correct += (class_ps == labels).sum().item()

print(f"Accuracy: {100 * correct / total}%")3. Scikit-learn案例:鸢尾花分类

python

from sklearn import datasets

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

# 加载数据集

iris = datasets.load_iris()

X = iris.data

y = iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 创建KNN分类器

knn = KNeighborsClassifier(n_neighbors=5)

# 训练模型

knn.fit(X_train, y_train)

# 评估模型

accuracy = knn.score(X_test, y_test)

print(f"Accuracy: {accuracy:.2f}")这些代码示例提供了使用不同工具进行机器学习任务的基本框架,包括数据预处理、模型构建、训练和评估。每个示例都是可运行的,并且可以根据需要进行调整和扩展。

三、2022 年 AI 研究盘点

(一)LaMA:基于傅里叶卷积的分辨率稳健的大型掩码修复

- 特点:可以轻松清除图像中不需要的内容,如人或垃圾桶等。就像口袋里的专业 ps 设计师,只需轻轻一按即可完成修复。虽然操作看似简单,但图像修复一直是许多 AI 研究人员长期致力解决的问题。

- 应用:在图像处理领域有广泛应用,可用于修复旧照片、去除图片中的干扰元素等,为图像编辑工作带来极大便利。

(二)STIT:基于 GAN 的真实视频人脸编辑

- 特点:使用基于人工智能的算法,可实现让人脸增加笑容、看起来更年轻或更老等效果,代表了 2022 年视频人脸编辑的最新技术水平。

- 应用:在影视制作、社交媒体等领域有很大潜力。例如在电影制作中,可以用于特效制作,轻松实现演员的年龄变化等效果;在社交媒体上,用户可以使用该技术对自己的视频进行个性化编辑,增加趣味性。

(三)NeROIC:利用在线图库的神经渲染

- 特点:通过图像理解物体的物理形状,解决了机器在不同光照条件和角度下生成模型变化的问题。可将 2D 照片或视频转化成 3D 模型,为开发 AR 内容提供新方案。

- 应用:应用场景广泛,如 3D 地图、AR/VR、数字孪生等。在未来互联网从 2D 向 3D 升级的过程中,有望加速这一进程。例如在游戏开发中,可减少人工 3D 开发的时间和成本,提高游戏的视觉效果。

(四)SpeechPainter:文本条件下的语音修复

- 特点:谷歌的研究人员提出的全新语音修复方法,不仅可以保持帧与帧之间的一致性,避免生成错误伪影,还能纠正视频中的语法、发音,甚至消除背景噪音。

- 应用:在视频制作、音频处理等领域有重要作用。例如在电影后期制作中,可以修复音频中的瑕疵,提高影片的质量;在语音识别系统中,可以提高识别的准确性。

(五)GFP-GAN:利用生成性面部先验,实现真实世界的盲脸修复

- 特点:免费的 AI 模型,能在一瞬间修复大部分旧照片,即使画质非常低也能很好地工作。开源了代码,创建了演示和在线应用程序供大家试用。

- 应用:可以帮助人们修复老照片,让珍贵的回忆更加清晰。在摄影、图像修复等行业有广泛应用,为用户提供了便捷的照片修复工具。

(六)4D-Net:多模态对齐的学习

- 特点:解答了车企使用的 LiDAR 传感器等奇怪相机如何工作、如何观察世界以及与人类看到的有何不同等问题。结合普通摄像头和 3D LiDAR 传感器,生成 3D 点云,测量物体距离,计算脉冲激光传播时间。

- 应用:在自动驾驶领域有重要意义。可以帮助自动驾驶汽车更好地理解周围环境,提高自动驾驶的安全性和可靠性。

四、2020 年度 AI 经典论文

(一)用于地震预警的分布式多传感器机器学习方法

- 荣誉:获得 AAAI 2020 杰出论文奖。

- 摘要:本研究旨在通过机器学习提高地震预警系统(EEW)的准确性,设计核心是在中大型地震破坏性影响到达特定区域前探测出来。传统 EEW 方法基于地震检波器,对地震运动速度敏感,难以准确识别大地震;高精度 GPS 站点易产生大量嘈杂数据,在检测中等强度地震方面效果不佳。EEW 可看作机器学习中的分类问题,多传感器数据为输入,地震强烈程度为输出。本文介绍了基于机器学习的分布式多传感器地震预警系统(DMSEEW),结合 GPS 站台和地震仪的数据进行探测,基于堆栈集成方式,经地理科学家验证,基于分布式基础设施确保响应时间和鲁棒性。实验结果表明,DMSEEW 方法比传统方法和组合传感器方法具有更高精确度。

- 核心思想:现有的早期地震预警解决方案效果不佳,作者介绍了分布式多传感器地震预警(DMSEEW)算法,采用地震检波器和 GPS 站的传感器级预测,使用词袋表示汇总预测并定义地震类别最终预测,还引入分布式网络基础设施,支持实时处理大量数据并在灾难情况下重定向数据。

(二)通过高斯过程后验进行快速采样方法

- 荣誉:获得 ICML 2020 荣誉奖。

- 摘要:作者探索了从高斯过程(GP)后验有效采样的技术,研究朴素采样和快速逼近策略后,发现许多策略互补,引入结合不同采样方法的新方法。先将后验分解为先验和更新的总和,再与近似 GP 的文献技术结合,获得易于使用的通用快速后验采样方法。实验表明,解耦的样本路径可以更低成本准确表示 GP 的后验。

- 核心思想:从 GP 后验采样函数的方法基于将高斯随机变量与显式校正项组合来调节高斯随机变量的直觉,转化为高斯过程后建议将后验分解为先验和更新的总和,在此基础上提出快速后验采样方法,可与稀疏近似值配对实现可伸缩性。

(三)迈向拟人化的开放域聊天机器人

- 荣誉:[具体荣誉暂未提及]

- 摘要:致力于开发迈向拟人化的开放域聊天机器人,旨在为用户提供更加自然、流畅的交互体验。

- 核心思想:通过不断学习和优化语言模型,提高聊天机器人的智能水平和拟人化程度,使其能够更好地理解用户的意图和情感,并做出恰当的回应。

(四)语言模型是小样本学习者

- 荣誉:[具体荣誉暂未提及]

- 摘要:研究表明语言模型在小样本情况下具有强大的学习能力,能够快速适应新的任务和领域。

- 核心思想:利用少量的样本数据进行训练,语言模型可以通过学习样本中的模式和规律,实现对新任务的准确预测和理解。

(五)超越准确度标准:使用 CheckList 对 NLP 模型进行行为测试

- 荣誉:[具体荣誉暂未提及]

- 摘要:提出使用 CheckList 对 NLP 模型进行行为测试,超越传统的准确度标准,全面评估模型的性能。

- 核心思想:通过设计一系列的测试用例和指标,CheckList 可以对 NLP 模型的各种行为进行细致的测试,发现模型的潜在问题和不足,为模型的改进提供指导。

(六)EfficientDet:可扩展和高效的目标检测

- 荣誉:为 CVPR 2020 所接收。

- 摘要:模型效率在计算机视觉中越来越重要,本文系统研究了用于目标检测的神经网络体系结构设计选择,提出提高效率的关键优化方案。提出加权双向特征金字塔网络(BiFPN),可快速融合多尺度特征;提出混合缩放方法,同时缩放所有主干、特征网络和 box/class 预测网络的分辨率、深度和宽度。基于这些优化开发了 EfficientDet,在广泛资源约束范围内达到比现有技术更好的数量级效率。

- 核心思想:为提高目标检测模型效率,提出加权双向特征金字塔网络用于多尺度特征融合,了解不同输入特征重要性并反复应用自上而下和自下而上的融合;提出混合缩放方法,同时缩放多个网络部分的分辨率、深度和宽度,与 EfficientNet 主干一起开发新的目标检测器系列。

(七)对可能对称的、可变形的 3D 物体类别,进行无监督学习

- 荣誉:获得 CVPR 2020 最佳论文奖。

- 摘要:提出基于原始单目图像学习 3D 可变形物体类别的无监督方法。基于自动编码器将输入图像分解为深度、反照度、视点和光照四个组件,利用许多对象类别具有对称结构的事实解开这些成分,对不完全对称的实例通过直接对光照建模和扩充模型解决问题,可准确恢复人脸、猫脸和汽车的三维形状。

- 核心思想:算法必须使用无约束的单目图像集合,无同一实例的多个视图,通过利用对象对称结构和解决不对称问题,实现无监督的 3D 物体类别学习。

(八)用于大规模图像识别的转换器

- 荣誉:[具体荣誉暂未提及]

- 摘要:提出用于大规模图像识别的转换器,为图像识别领域提供新的解决方案。

- 核心思想:基于转换器架构,对大规模图像进行识别,通过学习图像中的特征和模式,实现准确的图像分类和识别任务。

(九)AdaBelief 优化器:根据观察梯度的 Blief 调整步长

- 荣誉:[具体荣誉暂未提及]

- 摘要:介绍 AdaBelief 优化器,根据观察梯度的信念调整步长,提高优化算法的性能。

- 核心思想:通过对观察梯度的分析和信念调整,优化器可以更准确地调整步长,实现更高效的模型训练和优化。

(十)ALBERT:语言表示自监督学习的轻量 BERT

- 荣誉:[具体荣誉暂未提及]

- 摘要:提出 ALBERT,一种语言表示自监督学习的轻量 BERT,在保持性能的同时减少模型参数。

- 核心思想:通过共享参数和优化训练方法,ALBERT 实现了轻量级的语言表示学习,为大规模语言处理任务提供高效的解决方案。

五、人工智能相关论文示例

(一)Wide and Deep Network

- 简介:Wide and Deep Network(Wide & Deep Learning for Recommender Systems)于 2016 年被提出,旨在解决推荐系统中的 memorization 和 generalization 问题。

- 总体网络:典型的推荐系统整体架构包括用户产生 query,检索模块返回相关 app 组成的列表,精排模块对候选列表进行排名并返回推荐结果。Wide&Deep 模型主要用于精排模块,包含线性模型和神经网络模型。

- Wide 网络:特征包括原始输入特征和转换后特征,通过交叉积转换函数定义交叉特征,输入为 one-hot 的类别特征、交叉特征和连续特征,以提高 memorization,但模型表达能力不强,容易欠拟合。

- Deep 网络:使用类别特征和连续特征,输入层为未经过 one-hot 的离散特征,第一层为 Embedding 层,将高维稀疏的类别特征转换成低维的 Embedding 向量,第二层为特征拼接层,将所有 Embedding 向量拼接成一个 dense feature 向量,后续是全连接层,具有泛化能力强但容易过拟合的特点。

- Wide&Deep 整体:结合 Wide 网络和 Deep 网络,共同训练,在 LR 模型中,Wide 线性模型可记住稀疏特征交叉,Deep 神经网络可通过低维 Embedding 获得未见过的特征交叉,具有泛化性能。

(二)Adam

- 介绍:Adam 是一种有效的随机优化方法,根据梯度的第一和第二矩的估计来计算不同参数的各个自适应学习速率,名称来源于自适应矩估计。

- 算法原理:

-

- 算法简述:Adam 算法对梯度的一阶矩、二阶矩进行估计并应用于参数更新。

-

- 实现方式:通过计算梯度的一阶矩估计和二阶矩估计,为不同参数设计独立的自适应性学习率。

-

- 步长假设:参数更新的步长具有上界,可通过设置超参数确定迭代步长的上界。

-

- 初始化偏差矫正:通过除以特定值矫正偏差。

-

- 收敛性分析:通过分析 regret bound 证明其收敛性。

- 实验部分:在逻辑回归、多层神经网络以及卷积神经网络上表现良好,偏差矫正对优化结果有影响。

- AdaMax:在 Adam 的基础上进行拓展,将 L2 范数一般化至 LP 范数,得到更简单的算法,并可通过平均获得更好的泛化能力。

- 总结:Adam 结合 AdaGrad 和 RMSProp 两种算法的优点,在一般优化问题上具有良好表现。

人工智能相关论文在推动技术发展和创新方面发挥着重要作用。Wide and Deep Network 通过结合浅层和深层模型,提高了推荐系统的性能;Adam 优化算法则为深度学习中的参数更新提供了有效的方法。这些论文的研究成果为人工智能领域的进一步发展提供了理论支持和实践经验。

六、AI 顶刊文章资源

人工智能领域的发展日新月异,而顶刊文章则是了解该领域前沿动态的重要窗口。以下为大家提供一些人工智能顶刊文章、数据、代码和附录的下载资源以及相关数据截图。

一、数据来源及时间跨度

数据来源于《中国工业经济》和《数量经济技术经济研究》,时间跨度为 2020 - 2024 年。涵盖了文章、数据、代码和附录等丰富内容。

二、下载链接及内容示例

- 下载链接:人工智能、经济增长与居民消费改善:资本结构优化的视角。

- 下载链接:人工智能技术会诱致劳动收入不平等吗 —— 模型推演与分类评估。

数据截图:可在下载链接查看。

- 下载链接:基于专利数据的人工智能就业效应研究 —— 来自中关村企业的微观证据。

- 下载链接:人工智能技术应用与全球价值链竞争。

- 下载链接:人工智能与中国企业参与全球价值链分工。

- 下载链接:人工智能与全球价值链网络深化。

- 下载链接:人工智能、岗位结构变迁与服务型制造。

- 下载链接:人工智能技术方向、时间配置结构转型与人类劳动变革远景。

- 下载链接:人工智能时代的中国产业链 “延链补链”—— 基于制造业企业智能设备进口的微观证据。

- 下载链接:人工智能发展、干中学效应与技能溢价 —— 基于内生技术进步模型的分析。

这些顶刊文章资源涵盖了人工智能在经济、就业、全球价值链等多个领域的研究成果,对于深入了解人工智能的发展趋势和应用前景具有重要价值。无论是学术界的研究者还是工业界的从业者,都可以从中获取宝贵的知识和灵感。

七、写好 CSDN 人工智能文章的技巧

(一)选题与起标题

在 CSDN 上撰写人工智能文章,选题方向至关重要。可以从介绍最新的人工智能技术、记录学习人工智能知识的过程、分享人工智能程序代码或探讨编程中的问题等方面入手。

起好标题是吸引读者的关键。悬念化的标题能激发读者的好奇心,例如以自问自答的方式设置悬念,如 “人工智能能否真正理解人类情感?探索 AI 情感认知的奥秘”。突出化则通过布局关键词提高点击概率,如 “深度学习算法详解,AI 开发者必看”,明确文章内容并吸引精准读者。场景化用具体细节描述与读者相关的场景,如 “职场小白如何利用 AI 提升工作效率?真实案例分享”,让读者感同身受。反差化通过设置矛盾、冲突或反差对比吸引眼球,如 “传统编程 vs AI 编程,谁才是未来的王者?”。情绪化调动读者情绪,如 “震惊!AI 竟然能做到这些,你还在等什么?”

(二)撰文原则

结论先行是将核心观点或中心思想放在开头,先讲具体再讲细节。比如在介绍一种新的人工智能算法时,开篇就明确指出该算法的优势和应用场景。

以上统下是对上层结论进行概括总结,再用下层信息具体解释说明。例如,阐述人工智能在医疗领域的应用时,先概括人工智能在医疗领域的重要性,然后分别介绍在诊断、治疗、康复等方面的具体应用。

归类分组是把类似或相关联的信息按一定标准划分归类。比如将不同的人工智能算法按照应用领域进行分类介绍。

逻辑递进是按逻辑顺序排列信息。可以从人工智能的发展历程逐步过渡到当前的技术热点和未来趋势。

(三)发文技巧

采用总分总结构能使文章条理清晰。开头总述人工智能的重要性和发展现状,中间分别论述不同方面的内容,结尾总结全文并展望未来。

文章内容多分段,避免长篇大论,让读者阅读起来更轻松。每一段阐述一个小观点,并用清晰的过渡句连接。

图片紧密结合内容,例如在介绍人工智能算法的流程图时,插入相应的图片,使读者更直观地理解。选择封面图片要吸引眼球,可以是具有冲击力的人工智能应用场景图片或有趣的 AI 生成图像。

总之,掌握这些技巧,能帮助我们在 CSDN 上写出高质量的人工智能文章,吸引更多读者的关注和交流。

八、人工智能写作工具推荐

(一)Textio

- 生成速度:Textio 的生成速度较快,能够在短时间内为用户提供高质量的写作建议和内容。

- 易用性:Textio 的界面简洁直观,易于操作。用户可以快速上手,无需复杂的培训和学习过程。

- 优点:

-

- 强大的文本分析功能:Textio 能够分析文本的语法、拼写和标点错误,并提供修改建议,帮助用户提高文本质量。

-

- 实时协作功能:支持多人同时在线协作,方便团队成员之间的沟通与合作。

-

- 自定义写作风格:用户可以根据自己的写作风格和需求,定制化写作建议,让写作更加个性化。

-

- 多语言支持:支持多种语言,让用户在全球范围内使用该软件,拓展了其应用领域。

- 具体操作步骤:

-

- 步骤一:打开 Textio 官网,注册并登录账号。

-

- 步骤二:在文本编辑器中输入文章的主题或关键词,Textio 会自动分析并提供写作建议。

-

- 步骤三:根据 Textio 的建议进行修改和完善,直到满意为止。

(二)AI 写作

- 生成速度:AI 写作的生成速度非常快,能够在几秒钟内生成一篇高质量的文章。

- 易用性:AI 写作的操作简单方便,用户只需输入文章的主题或关键词,即可生成文章。

- 优点:

-

- 高效生成高质量文本内容:AI 写作可以根据用户输入的关键词或主题,自动生成从文字、句子到段落的全方位高质量文本内容。

-

- 自然语言处理技术:其 “AI 全能写作” 功能运用自然语言处理技术,能够理解用户的意图,并自动提供相应的写作建议,大大提高了写作效率。

-

- 多种实用功能:支持多种文体风格,包括新闻报道、科技文章、商业推广等,满足用户在不同场景下的写作需求。

- 具体操作步骤:

-

- 步骤一:安装 AI 写作软件或打开其在线平台。

-

- 步骤二:在界面的最前方,点击 “AI 全能写作” 功能。

-

- 步骤三:在出现的新界面中,输入要写作的主题或关键词,随后点击 “发送” 按钮。

-

- 步骤四:系统会自动为用户生成一篇高质量的文本内容,用户可以对其进行复制、修改和完善。

这两款人工智能写作工具各具特色,功能强大且实用。它们不仅提高了写作效率,还为创作者们带来了更多的创作灵感和可能性。用户可以根据自己的需求和喜好选择适合自己的写作工具。

九、机器学习与文本生成

(一)背景介绍与核心概念

机器学习是一种让计算机系统具备从数据中学习的能力,并通过学习不断优化和改进性能的技术。它主要分为监督学习、无监督学习和强化学习三种类型。

在监督学习中,通过已标记的数据进行训练,学习输入数据与输出标签之间的关系,以预测未知数据的标签。例如,在垃圾邮件检测中,通过已标记的 “垃圾邮件” 和 “非垃圾邮件” 数据来训练模型,从而对新邮件进行分类。

无监督学习则处理未标记的数据,探索数据之间的关系和结构。常见的无监督学习技术有聚类和主成分分析等。例如,将数据划分为多个不同的聚类,以发现数据中的潜在模式。

强化学习是让智能体在与环境交互中学习,通过奖励机制来优化决策。例如,国际象棋中,智能体根据棋盘状态决定行动,以赢得比赛为目标,通过不断尝试和学习来优化策略。

文本生成是利用机器学习技术自动生成自然语言文本的过程。文本生成的方法主要有以下几种:

- 语言模型:预测下一个词或字符的概率分布,常见的语言模型包括 n-gram 模型、循环神经网络和 Transformer 模型。

- 循环神经网络:可以处理序列数据,在生成文本方面表现良好。通过在每个时间步生成一个词或字符,并将其作为下一个时间步的输入,逐步生成连续的文本。

- 长短期记忆网络:一种特殊类型的循环神经网络,通过门控机制更好地捕捉长期依赖关系,常用于生成连贯的句子或段落。

- 生成对抗网络:由生成器和判别器组成,生成器通过学习数据的分布来生成新的文本样本,判别器则试图区分真实文本和生成的文本,通过对抗训练生成更逼真的文本。

- 变分自编码器:通过学习数据的潜在分布来生成新的文本样本,可通过随机采样和解码生成多样化的文本。

- Transformer 模型:基于自注意力机制的神经网络模型,适用于处理长文本序列,在机器翻译和文本生成任务中表现出色。

机器学习与文本生成密切相关。机器学习的各种方法为文本生成提供了技术支持,例如,基于 Transformer 的 GPT 模型就是一种利用机器学习技术进行文本生成的强大工具。

(二)GPT 核心算法原理

GPT(Generative Pre-trained Transformer)是一种基于变压器的文本生成模型。其核心算法原理基于 Transformer 架构的自注意力机制。

自注意力机制可以帮助模型学习输入序列中的长距离依赖关系。具体操作步骤如下:

- 输入分词:GPT 模型使用词汇表将输入文本划分为一个个单词。

- 位置编码:为输入的单词序列添加位置编码,以便模型能够识别单词之间的顺序。

GPT 的数学模型可以表示为:Output = Decoder (Encoder (Input))。其中,Input 是输入文本,Encoder 是编码器,将输入文本编码成向量表示,Decoder 是解码器,根据编码器输出的向量表示,生成目标文本。

Transformer 的算法步骤详解如下:

- 编码器:将输入文本编码成向量表示。通过自注意力机制,计算每个单词与其他单词的关联程度,从而更好地理解输入文本的语义。

- 注意力机制:计算每个词语之间的注意力权重,以确定每个词语对其他词语的影响程度。具体公式为:Attention (Q,K,V)=softmax (QKT√dk) V,其中 Q 是查询矩阵,表示要查询的词语;K 是键矩阵,用于与查询矩阵进行匹配;V 是值矩阵,包含了输入序列的信息。

- 解码器:根据编码器输出的向量表示,生成目标文本。解码器同样利用自注意力机制和编码器 - 解码器注意力机制,逐步生成输出文本。

Transformer 的算法优缺点如下:

优点:

- 能够捕捉长距离依赖关系:传统的循环神经网络在处理长文本时,容易出现梯度消失问题,而 Transformer 能够有效地解决这个问题。

- 并行计算能力强:Transformer 的计算过程可以并行化,从而提高模型的训练速度。

缺点:

- 计算量大:Transformer 的计算量比较大,需要大量的计算资源。

- 可解释性差:Transformer 的内部机制比较复杂,难以解释模型的预测结果。

GPT 作为一种基于 Transformer 的语言模型,其训练过程包括预训练和微调两个阶段。预训练阶段在大规模文本语料上进行无监督学习,学习语言的一般规律。微调阶段针对特定任务,在预训练模型的基础上进行有监督的微调训练。公式表达为:θ∗=argmaxθ∑(x,y)∈DlogPθ(y|x),其中 θ∗是最佳参数,D 是训练数据集,Pθ(y|x) 是参数 θ 下的输出序列概率分布。

十、CSDN 平台上 AI 的发展趋势

(一)2023 年在 CSDN 的收获

2023 年对于在 CSDN 平台上的开发者和研究者来说,是充满收获的一年。许多人入围了博客之星,这不仅是对个人技术能力和写作水平的认可,更是一种激励。例如,有人获得了 1767 名粉丝的关注,通过分享高质量的技术文章,收获了很多正向的反馈,如赞、评论、阅读量等。同时,不少人通过创作者身份认证,这意味着他们的技术实力和创作能力得到了官方的认可。在 CSDN 平台上,还可以参加各种征文活动,如《有哪些让你目瞪口呆的 Bug?》征文,获得 TOP3 的成绩,不仅展示了自己在解决实际问题方面的能力,还吸引了大量的粉丝关注。此外,多篇文章被城市开发者社区收录,进入全站综合热榜,这表明文章内容具有较高的价值和影响力,能够为广大开发者提供帮助和启发。

(二)2023 年 AI 发展浪潮

2023 年,AI 发展浪潮席卷全球。ChatGPT 的出现带来了大模型发展热潮,引领众多头部互联网企业形成 “百模大战”。微软宣布在 Excel 中使用 Python,结合了 Python 的强大功能和 Excel 的灵活性。谷歌推出 “最全能” AI 模型 Gemini,正面对决 GPT - 4。埃隆・马斯克成立四个月的 AI 公司推出聊天机器人 Grok。百度率先发布国内首个大语言模型 —— 文心一言。阿里推出的中文 AI 大模型系列:通义千问、通义万相、通义灵码。讯飞星火号称 AI 领域的「出国不头疼」。微软推出 Copilot,ChatGPT 高度结合微软 Edge、Microsoft365 全家桶。联想发布全球首款 AI PC:可运行「个人大模型」。2023 年 8 月份,由国家网信办等七部门发布的《生成式人工智能服务管理暂行办法》正式实施。这些大事标志着 AI 技术在 2023 年取得了重大突破,也为未来的发展奠定了基础。

(三)CSDN 在 AI 行业的作用

CSDN 在 AI 行业百模大战中发挥着重要作用。首先,它提供了一个技术交流平台,让全球的技术大咖们纷纷分享着最前沿的 AI 技术进展。无论是深度学习的算法优化还是自然语言处理的新思路,都在 CSDN 上得到了深度解读。其次,CSDN 成为了展示 AI 应用的重要平台。技术博客、开源项目、案例分析等多维度的展示方式,使得 AI 技术的广泛应用得以更加直观地呈现在技术爱好者的眼前。通过 CSDN,AI 的边界被不断扩展,行业的创新也得以更加生动地呈现。再者,CSDN 开创了 AI 行业交流新模式。从技术大会的在线直播到专业技术文章的发布,CSDN 为 AI 行业搭建了一个新的信息传播模式。这种开放、多元的行业交流模式不仅推动了行业内知识的传播,也为企业创新和发展提供了更为高效的沟通平台。最后,CSDN 孕育了 AI 领域的未来之星。通过在 CSDN 上的技术博客、项目分享、问题解答等方式,AI 人才得以更加全面地展示自己的实力。这不仅为人才的职业发展提供了更为广阔的平台,也让企业更容易发现并吸引到优秀的 AI 人才。

(四)AI 在 IT 领域的应用与未来趋势

人工智能在 IT 领域的应用案例丰富多样。在数据分析方面,通过使用机器学习和深度学习算法,可以快速处理和分析海量数据,发现其中的潜在模式和趋势。例如,广告公司可以通过分析用户的浏览和购买行为来优化广告投放策略,从而提高转化率和收益。在机器学习方面,让计算机能够从经验中学习并自动改善性能。在 IT 领域,机器学习被广泛应用于图像识别、语音识别、自然语言处理等任务中。例如,社交媒体公司可以使用机器学习算法自动识别和过滤有害内容,保护用户的隐私和安全。在自然语言处理方面,使得机器能够理解、分析和生成人类语言。例如,智能助理可以通过语音识别和自然语言理解技术与用户进行对话,帮助他们完成各种任务。在智能辅助决策方面,通过分析大量的数据和模拟不同的决策方案,人工智能可以提供决策者有价值的洞察和建议。例如,金融公司可以利用人工智能算法来进行投资决策和风险管理,提高投资回报率。

未来,人工智能在 IT 领域的发展趋势广阔。强化学习将通过与环境的互动来不断学习和优化决策,实现更多复杂任务的自动化,如自动驾驶、智能机器人等。边缘计算将成为实现智能决策和实时响应的关键技术,人工智能在边缘设备上的应用将带来更快速、更智能的决策能力。联邦学习将在保护数据隐私的同时,实现模型的共享和融合,在医疗、金融等领域广泛应用。可解释性人工智能将能够解释自己决策和推理过程,增强人们对人工智能的理解和信任。同时,随着人工智能技术的快速发展,其对社会和人类的影响也日益凸显,伦理和社会影响将成为 IT 行业和社会关注的焦点。

学术会议

重要信息

参会网站:【参会入口】

截稿时间:以官网信息为准

大会时间:2024年11月8-10日

大会地点:中国-南京

提交检索:EI Compendex、Scopus

更多了解:【高录用 / 人工智能 / EI检索】2024年人工智能与数字图书馆国际学术会议(AIDL 2024)_艾思科蓝_学术一站式服务平台

*现场可领取会议资料(如纪念品、参会证书等),【click】投稿优惠、优先审核!

支持单位:

参会方式

1、作者参会:一篇录用文章允许1名作者免费参会;

2、主讲嘉宾:申请主题演讲,由组委会审核;

3、口头演讲:申请口头报告,时间为15分钟;

4、海报展示:申请海报展示,A1尺寸,彩色打印;

5、听众参会:不投稿仅参会,也可申请演讲及展示;

6、论文投稿、口头报告、海报展示、听众参会【参会入口】

写在最后

人工智能时代为程序员带来了新的挑战和机遇。通过发展复杂系统设计能力、跨学科知识整合能力和与AI协作的能力,程序员可以保持并提升自身的核心竞争力。同时,持续学习和明智的职业规划将帮助程序员在人机协作模式下实现职业发展。让我们一起拥抱AI时代,不断进化,成为更优秀的程序员。

博主写的跟人工智能相关文章推荐:

7、目前国内AI大厂大模型列表优缺点、原理、使用、案例和注意事项

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)