【机器学习】—机器学习和NLP预训练模型探索之旅

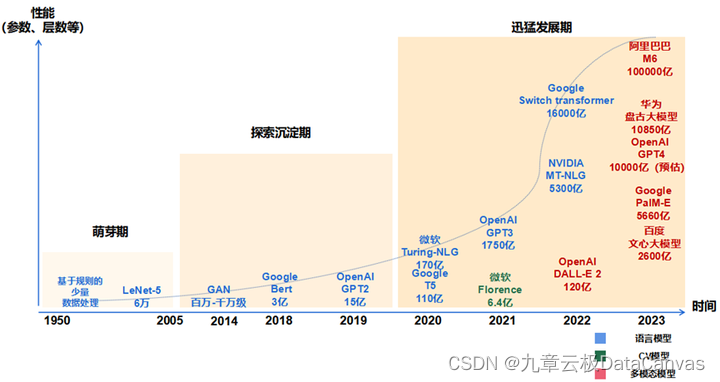

随着数据量的增加和计算能力的提升,机器学习和自然语言处理技术得到了飞速发展。预训练模型作为其中的重要组成部分,通过在大规模数据集上进行预训练,使得模型可以捕捉到丰富的语义信息,从而在下游任务中表现出色。

目录

目录

随着数据量的增加和计算能力的提升,机器学习和自然语言处理技术得到了飞速发展。预训练模型作为其中的重要组成部分,通过在大规模数据集上进行预训练,使得模型可以捕捉到丰富的语义信息,从而在下游任务中表现出色。

一.预训练模型的基本概念

预训练模型是一种在大规模数据集上预先训练好的模型,可以作为其他任务的基础。预训练模型的优势在于其能够利用大规模数据集中的知识,提高模型的泛化能力和准确性。常见的预训练模型包括BERT(Bidirectional Encoder Representations from Transformers)、GPT(Generative Pre-trained Transformer)等。

1.BERT模型

BERT是由Google提出的一种双向编码器表示模型。BERT通过在大规模文本数据上进行掩码语言模型(Masked Language Model, MLM)和下一句预测(Next Sentence Prediction, NSP)的预训练,使得模型可以学习到深层次的语言表示。

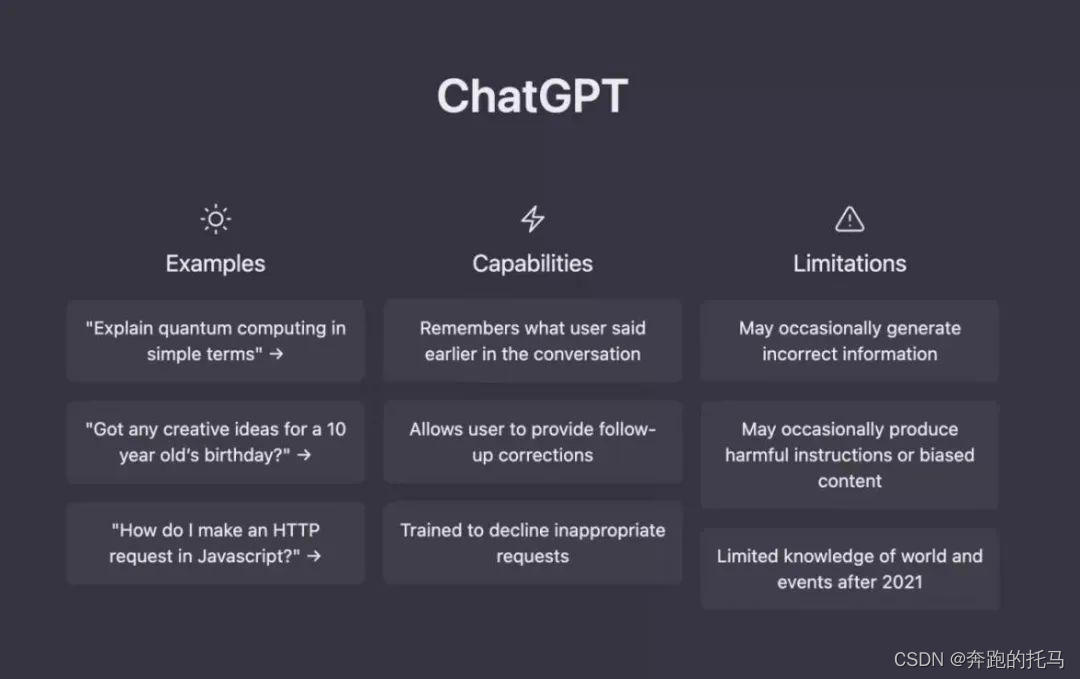

2 .GPT模型

GPT由OpenAI提出,是一种基于Transformer的生成式预训练模型。GPT通过在大规模文本数据上进行自回归语言模型的预训练,使得模型可以生成连贯的文本。

二、预训练模型的应用

预训练模型在NLP领域有广泛的应用,包括但不限于文本分类、问答系统、机器翻译等。以下将介绍几个具体的应用实例。

1.文本分类

文本分类是将文本数据按照预定义的类别进行分类的任务。预训练模型可以通过在大规模文本数据上进行预训练,从而捕捉到丰富的语义信息,提高文本分类的准确性。

使用BERT进行文本分类

import torch

from transformers import BertTokenizer, BertForSequenceClassification

from torch.utils.data import DataLoader, Dataset

from sklearn.model_selection import train_test_split

# 加载预训练的BERT模型和分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertForSequenceClassification.from_pretrained('bert-base-uncased', num_labels=2)

# 定义数据集

class TextDataset(Dataset):

def __init__(self, texts, labels, tokenizer, max_len):

self.texts = texts

self.labels = labels

self.tokenizer = tokenizer

self.max_len = max_len

def __len__(self):

return len(self.texts)

def __getitem__(self, idx):

text = self.texts[idx]

label = self.labels[idx]

encoding = self.tokenizer.encode_plus(

text,

add_special_tokens=True,

max_length=self.max_len,

return_token_type_ids=False,

padding='max_length',

return_attention_mask=True,

return_tensors='pt',

)

return {

'text': text,

'input_ids': encoding['input_ids'].flatten(),

'attention_mask': encoding['attention_mask'].flatten(),

'label': torch.tensor(label, dtype=torch.long)

}

# 准备数据

texts = ["I love this!", "I hate this!"]

labels = [1, 0]

train_texts, val_texts, train_labels, val_labels = train_test_split(texts, labels, test_size=0.1)

train_dataset = TextDataset(train_texts, train_labels, tokenizer, max_len=32)

val_dataset = TextDataset(val_texts, val_labels, tokenizer, max_len=32)

train_loader = DataLoader(train_dataset, batch_size=2, shuffle=True)

val_loader = DataLoader(val_dataset, batch_size=2, shuffle=False)

# 训练模型

optimizer = torch.optim.Adam(model.parameters(), lr=1e-5)

for epoch in range(3):

model.train()

for batch in train_loader:

optimizer.zero_grad()

input_ids = batch['input_ids']

attention_mask = batch['attention_mask']

labels = batch['label']

outputs = model(input_ids=input_ids, attention_mask=attention_mask, labels=labels)

loss = outputs.loss

loss.backward()

optimizer.step()

# 验证模型

model.eval()

correct = 0

total = 0

with torch.no_grad():

for batch in val_loader:

input_ids = batch['input_ids']

attention_mask = batch['attention_mask']

labels = batch['label']

outputs = model(input_ids=input_ids, attention_mask=attention_mask)

_, predicted = torch.max(outputs.logits, dim=1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print(f'Validation Accuracy: {correct / total:.2f}')2. 问答系统

问答系统是从文本中自动提取答案的任务。预训练模型可以通过在大规模问答数据上进行预训练,从而提高答案的准确性和相关性。

使用BERT进行问答

from transformers import BertForQuestionAnswering

# 加载预训练的BERT问答模型

model = BertForQuestionAnswering.from_pretrained('bert-large-uncased-whole-word-masking-finetuned-squad')

# 输入问题和上下文

question = "What is the capital of France?"

context = "Paris is the capital of France."

# 编码输入

inputs = tokenizer.encode_plus(question, context, return_tensors='pt')

# 模型预测

outputs = model(**inputs)

start_scores = outputs.start_logits

end_scores = outputs.end_logits

# 获取答案的起始和结束位置

start_idx = torch.argmax(start_scores)

end_idx = torch.argmax(end_scores) + 1

# 解码答案

answer = tokenizer.convert_tokens_to_string(tokenizer.convert_ids_to_tokens(inputs['input_ids'][0][start_idx:end_idx]))

print(f'Answer: {answer}')三、预训练模型的优化

在实际应用中,预训练模型的优化至关重要。常见的优化方法包括模型压缩、量化和蒸馏等。

1.模型压缩

模型压缩是通过减少模型参数数量和计算量来提高模型效率的方法。压缩后的模型不仅运行速度更快,还能减少存储空间和内存占用。常见的模型压缩技术包括剪枝、量化和知识蒸馏等。

1.1 剪枝

剪枝(Pruning)是一种通过删除模型中冗余或不重要的参数来减小模型大小的方法。剪枝可以在训练过程中或训练完成后进行。常见的剪枝方法包括:

- 权重剪枝(Weight Pruning):删除绝对值较小的权重,认为这些权重对模型输出影响不大。

- 结构剪枝(Structured Pruning):删除整个神经元或卷积核,减少模型的计算量和存储需求。

剪枝后的模型通常需要重新训练,以恢复或接近原始模型的性能。

权重剪枝

import torch

import torch.nn.utils.prune as prune

# 定义一个简单的模型

class SimpleModel(torch.nn.Module):

def __init__(self):

super(SimpleModel, self).__init__()

self.fc = torch.nn.Linear(10, 10)

def forward(self, x):

return self.fc(x)

model = SimpleModel()

# 对模型的全连接层进行权重剪枝

prune.l1_unstructured(model.fc, name='weight', amount=0.5)

# 查看剪枝后的权重

print(model.fc.weight)2.模型量化

模型量化是通过降低模型参数的精度来减少计算量的方法。量化通常通过将浮点数表示的权重和激活值转换为低精度表示(如8位整数)来实现。这可以显著减少模型的存储空间和计算开销,同时在硬件上加速模型推理。

2.1 定点量化

定点量化(Fixed-point Quantization)是将浮点数表示的权重和激活值转换为固定精度的整数表示。常见的定点量化包括8位整数量化(INT8),这种量化方法在不显著降低模型精度的情况下,可以大幅提升计算效率。

使用PyTorch进行定点量化

import torch

import torch.quantization

# 加载预训练模型

model = SimpleModel()

# 定义量化配置

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

# 准备量化模型

model = torch.quantization.prepare(model, inplace=True)

# 模拟量化后的推理过程

# 这里应该使用训练数据对模型进行微调,但为了简单起见,省略此步骤

model = torch.quantization.convert(model, inplace=True)

# 查看量化后的模型

print(model)3. 知识蒸馏

知识蒸馏(Knowledge Distillation)是通过将大模型(教师模型,Teacher Model)的知识转移到小模型(学生模型,Student Model)的方法,从而提高小模型的性能和效率。知识蒸馏的核心思想是通过教师模型的软标签(soft labels)指导学生模型的训练。

3.1 知识蒸馏的基本原理

在知识蒸馏过程中,学生模型不仅学习训练数据的真实标签,还学习教师模型对训练数据的输出,即软标签。软标签包含了更多的信息,比如类别之间的相似性,使学生模型能够更好地泛化。

蒸馏损失函数通常由两部分组成:

- 交叉熵损失:衡量学生模型输出与真实标签之间的差异。

- 蒸馏损失:衡量学生模型输出与教师模型软标签之间的差异。

总体损失函数为这两部分的加权和。

3.2 实例代码:使用知识蒸馏训练学生模型

import torch

import torch.nn.functional as F

from torch.utils.data import DataLoader, TensorDataset

# 定义教师模型和学生模型

teacher_model = SimpleModel()

student_model = SimpleModel()

# 加载示例数据

data = torch.randn(100, 10)

labels = torch.randint(0, 10, (100,))

dataset = TensorDataset(data, labels)

data_loader = DataLoader(dataset, batch_size=10, shuffle=True)

# 定义蒸馏训练函数

def distillation_train(student_model, teacher_model, data_loader, optimizer, temperature=2.0, alpha=0.5):

teacher_model.eval()

student_model.train()

for data, labels in data_loader:

optimizer.zero_grad()

# 教师模型输出

with torch.no_grad():

teacher_logits = teacher_model(data)

# 学生模型输出

student_logits = student_model(data)

# 计算蒸馏损失

loss_ce = F.cross_entropy(student_logits, labels)

loss_kl = F.kl_div(

F.log_softmax(student_logits / temperature, dim=1),

F.softmax(teacher_logits / temperature, dim=1),

reduction='batchmean'

) * (temperature ** 2)

loss = alpha * loss_ce + (1.0 - alpha) * loss_kl

loss.backward()

optimizer.step()

# 定义优化器

optimizer = torch.optim.Adam(student_model.parameters(), lr=1e-3)

# 进行蒸馏训练

for epoch in range(10):

distillation_train(student_model, teacher_model, data_loader, optimizer)

# 验证学生模型

student_model.eval()

correct = 0

total = 0

with torch.no_grad():

for data, labels in data_loader:

outputs = student_model(data)

_, predicted = torch.max(outputs, dim=1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print(f'Student Model Accuracy: {correct / total:.2f}')四、结论

预训练模型在机器学习和自然语言处理领域具有重要意义。通过在大规模数据集上进行预训练,模型可以捕捉到丰富的语义信息,从而在下游任务中表现出色。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)