【基于Transformer模型的时序数据回归预测】——多输入多输出预测

Transformer模型最初是为了解决自然语言处理(NLP)任务而设计的,但其独特的结构和机制使其也非常适用于处理时序数据。我们将详细介绍Transformer在时序数据回归预测中的应用步骤、存在的挑战以及一些可能的改进方法。Transformer模型基于自注意力机制(self-attention mechanism),能够捕捉序列内的长距离依赖关系。与传统的循环神经网络(RNN)或长短期记忆网

文章目录

- 前言

- Transformer模型简介

- 使用Transformer进行时序数据回归预测

- 1.数据预处理

- 2.模型结构调整

- 3.位置编码

- 4.训练模型

- 5.评估和改进

- 挑战和改进

前言

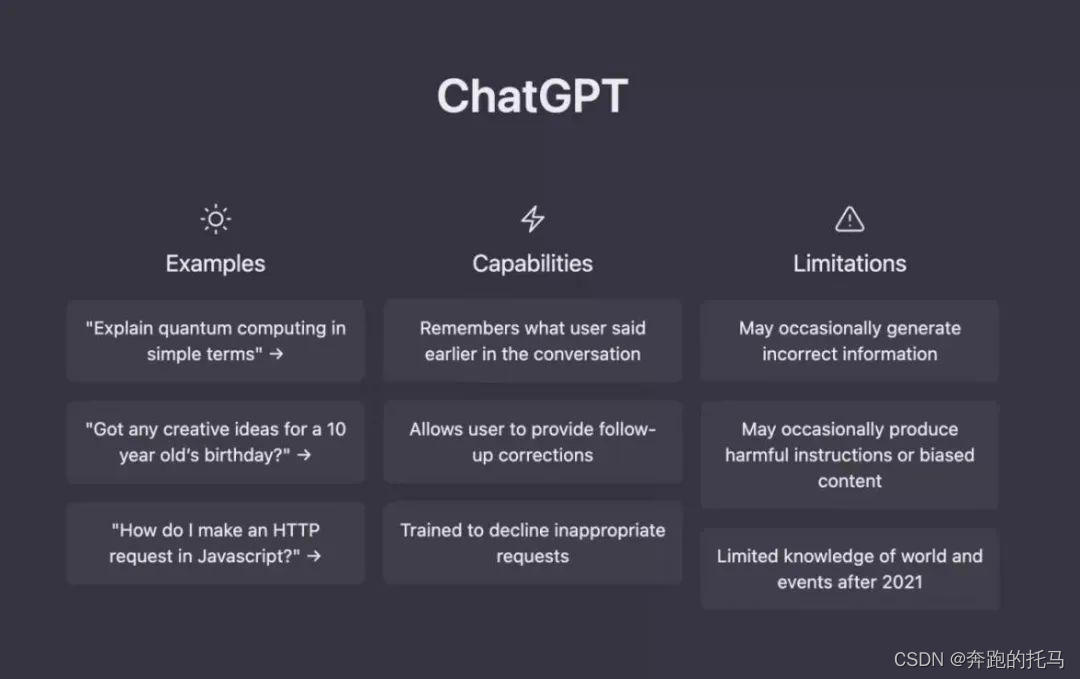

Transformer模型最初是为了解决自然语言处理(NLP)任务而设计的,但其独特的结构和机制使其也非常适用于处理时序数据。我们将详细介绍Transformer在时序数据回归预测中的应用步骤、存在的挑战以及一些可能的改进方法。

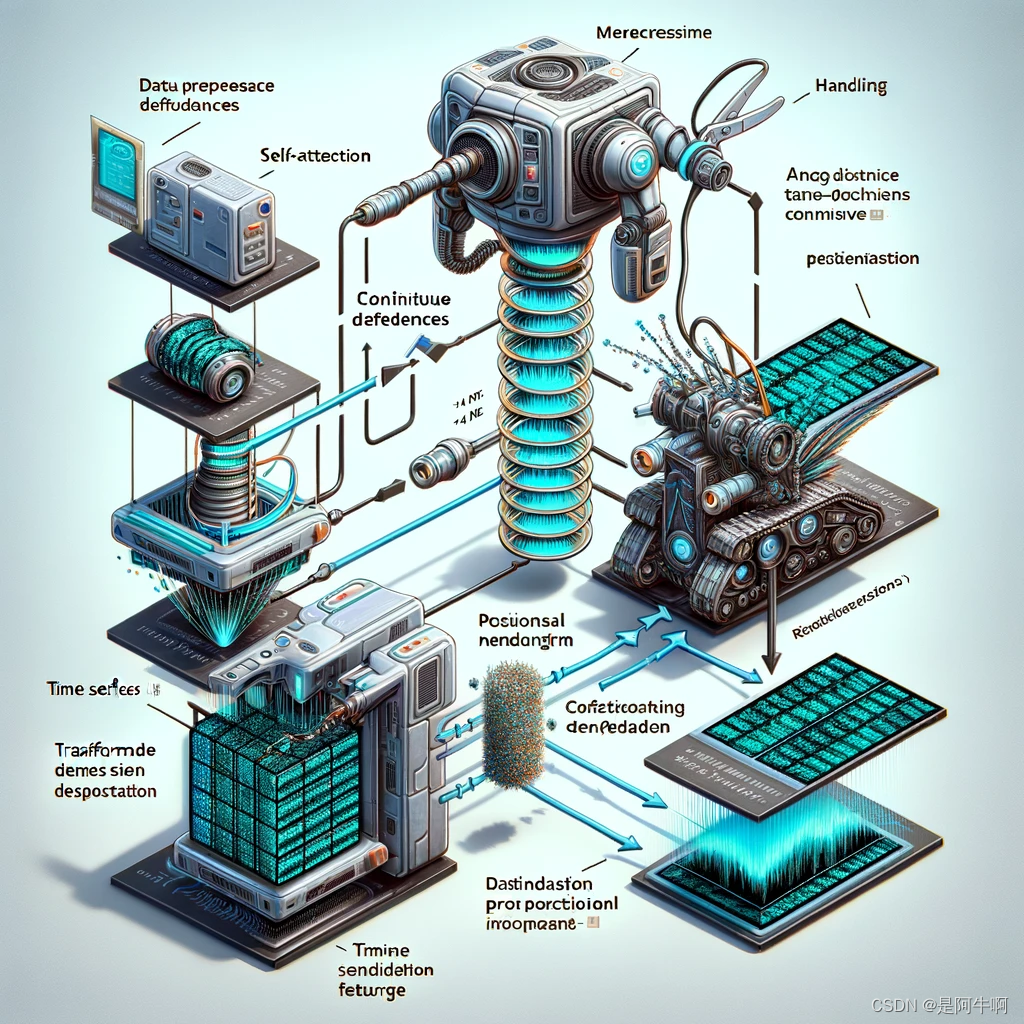

Transformer模型简介

Transformer模型基于自注意力机制(self-attention mechanism),能够捕捉序列内的长距离依赖关系。与传统的循环神经网络(RNN)或长短期记忆网络(LSTM)相比,Transformer能够更高效地处理长序列数据,并且训练过程更容易并行化。

使用Transformer进行时序数据回归预测

1.数据预处理

在使用Transformer处理时序数据之前,首先需要对数据进行适当的预处理。这可能包括数据标准化、缺失值处理、以及将时间序列转换为模型能够处理的格式。

2.模型结构调整

虽然Transformer模型在NLP领域表现出色,但要将其应用于时序数据回归预测,可能需要对其结构进行一些调整。例如,可以修改模型的输入层,使其能够接受连续的时序数据特征。

3.位置编码

由于Transformer模型本身不具有处理序列顺序的能力,因此需要通过位置编码(Positional Encoding)向模型提供时间信息。在处理时序数据时,这一点尤为重要。

4.训练模型

使用适当的损失函数和优化器训练Transformer模型。对于回归预测任务,通常使用均方误差(MSE)作为损失函数。

5.评估和改进

在训练完成后,评估模型的性能,并根据需要进行调整。可能的改进方法包括调整模型结构、增加训练数据、或使用不同的位置编码策略。

挑战和改进

虽然Transformer模型在处理时序数据方面表现出色,但也存在一些挑战,如对于非常长的时间序列,模型的计算和存储需求可能会非常大。为了解决这些问题,研究人员提出了多种改进方法,包括稀疏自注意力机制和模型压缩技术等。

代码如下:

import torch

import torch.nn as nn

import numpy as np

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler, MinMaxScaler

from sklearn.metrics import mean_squared_error, mean_absolute_error, r2_score

import matplotlib

matplotlib.use('Agg')

import matplotlib.pyplot as plt

import math

class TransformerModel(nn.Module):

def __init__(self, input_dim, output_dim, nhead, num_layers):

super(TransformerModel, self).__init__()

self.model_type = 'Transformer'

self.src_mask = None

self.pos_encoder = PositionalEncoding(input_dim)

encoder_layers = nn.TransformerEncoderLayer(input_dim, nhead, dim_feedforward=512)

self.transformer_encoder = nn.TransformerEncoder(encoder_layers, num_layers)

self.encoder = nn.Linear(input_dim, input_dim)

self.decoder = nn.Linear(input_dim, output_dim)

def forward(self, src):

print(f"Initial shape: {src.shape}")

if self.src_mask is None or self.src_mask.size(0) != len(src):

device = src.device

mask = self._generate_square_subsequent_mask(len(src)).to(device)

self.src_mask = mask

src = self.encoder(src)

print(f"After encoder: {src.shape}")

src = self.pos_encoder(src)

print(f"After positional encoding: {src.shape}")

output = self.transformer_encoder(src, self.src_mask)

print(f"After transformer encoder: {output.shape}")

output = self.decoder(output)

print(f"Final output shape: {output.shape}")

# 如果你只关心每个序列的最后一个时间步的输出:

final_output = output[:, -1, :] # 这会给你一个形状为 [574, 3] 的张量

print(f"Final final_output shape: {final_output.shape}")

return final_output

def _generate_square_subsequent_mask(self, sz):

mask = (torch.triu(torch.ones(sz, sz)) == 1).transpose(0, 1)

mask = mask.float().masked_fill(mask == 0, float('-inf')).masked_fill(mask == 1, float(0.0))

return mask

...

...

迭代20次的loss值曲线(全部代码可私信博主)

迭代20次的loss值曲线(全部代码可私信博主)

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)